AIの進歩による仕事の変化について、

こうなるだろうという完全自動化の理想と現実の間には大きなギャップが存在します。

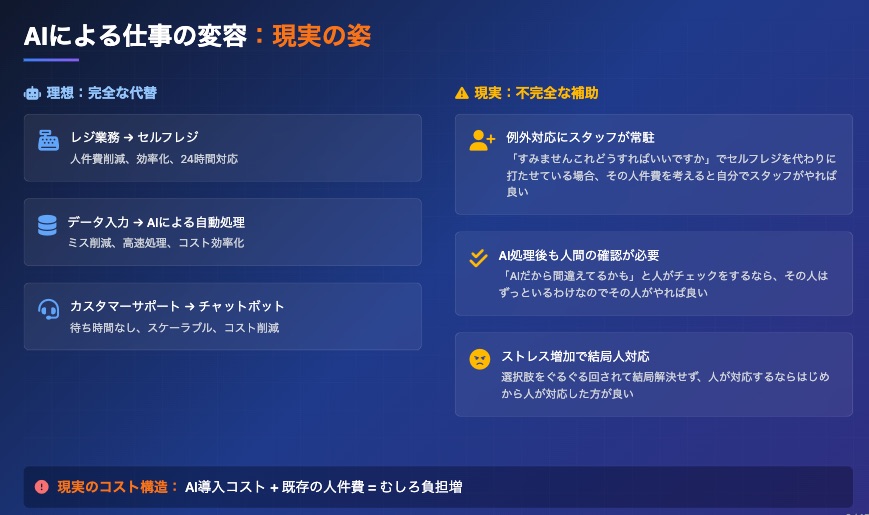

特にレジ業務、データ入力、カスタマーサポートといった分野では、AIが人の仕事を「完全に代替」するのではなく、「不完全な補助」に留まっている現状が見られます。

AIによる仕事の「理想:完全な代替」の側面

AIやロボットの導入は、当初、以下のような理想的な効果が期待されていました:

• レジ業務 → セルフレジ:

◦ 期待される効果:人件費の削減、作業効率の向上、24時間対応など、店舗運営のコスト削減と利便性向上が見込まれていました。

• データ入力 → AIによる自動処理:

◦ 期待される効果:入力ミス削減、処理の高速化、そしてそれに伴うコスト効率の向上が期待されていました。

• カスタマーサポート → チャットボット:

◦ 期待される効果:顧客の待ち時間解消、多くの問い合わせに同時に対応できるスケーラビリティ、人件費削減によるコストカットが見込まれていました。

AI導入の「現実:不完全な補助」の側面

しかし、現実の現場ではこれらのAI・自動化技術が「完全代替」には至っておらず、人間のリソースが引き続き必要とされる場面が多く見られます。

• レジ業務における不完全な補助:

◦ 「すみませんこれどうすればいいですか」でスタッフが対応: セルフレジにない商品があったり、顧客が商品の探し方や操作に戸惑ったりする場面では、結局スタッフが呼ばれ、代わりにレジを打つことがあります。この場合、顧客自身が操作を完結できないため、スタッフが常駐することになり、人的コストがゼロにはなっていません。ご指摘の通り、その人件費を考えると、スタッフが最初から対応した方が効率的ではないかという疑問が生じます。

• データ入力における不完全な補助:

◦ AI処理後も人間の確認が必要: AIによる自動データ処理は進んでいますが、「AIだから間違えているかも」という懸念から、最終的に人間によるチェックが必要とされることが少なくありません。人がチェックのために存在し続けるのであれば、その人が最初から業務を行った方が良いという指摘も成り立ちます。これは、「AI+人」という形になり、むしろ作業工程が増えているケースであると言えます。

• カスタマーサポートにおける不完全な補助:

◦ ストレス増加で結局人対応: チャットボットが用意された選択肢をユーザーに繰り返し提示したり、簡潔な目的ベースの会話ができなかったりすると、ユーザーは「この選択肢がない」「Webで用意されていない回答はできない」といった状況に陥り、最終的にストレスを増大させるだけになります。その結果、有人対応に切り替える必要が生じ、**チャットボット導入コストに加えて有人対応の人件費も発生する「ダブルコスト」**となるケースが非常に多く見られます。

「人が必要になるケースがあるなら、最初から人がやれ」という矛盾が強く現れています。

企業体にとってのコスト複合化

これらの現状を踏まえると、企業はAI導入による「人件費削減」や「作業効率化」という理想とは裏腹に、**「コスト複合化」**という現実に直面しています。

• **AI導入コスト(開発・運用・保守)**が発生する。

• 既存の人員の維持が必要となる(特に日本では解雇が難しいという制度的制約があるため、即座の人員削減が困難)..。

• AIが対応できない**「例外」や「エラー」への新たな対応人員**が必要になる。

結果として、「AIを導入しても全体のコストが増える」事例は多数存在し、特に日本の雇用慣習においては、AI導入の恩恵をフルに受けにくい土壌があると言えるでしょう…。

このように、AIは多くの業務を効率化する「道具」である一方で、その活用には人間の「知性と責任」が不可欠であり、AIの導入は企業のコスト構造や働き方を大きく変える過渡期にあると言えます。

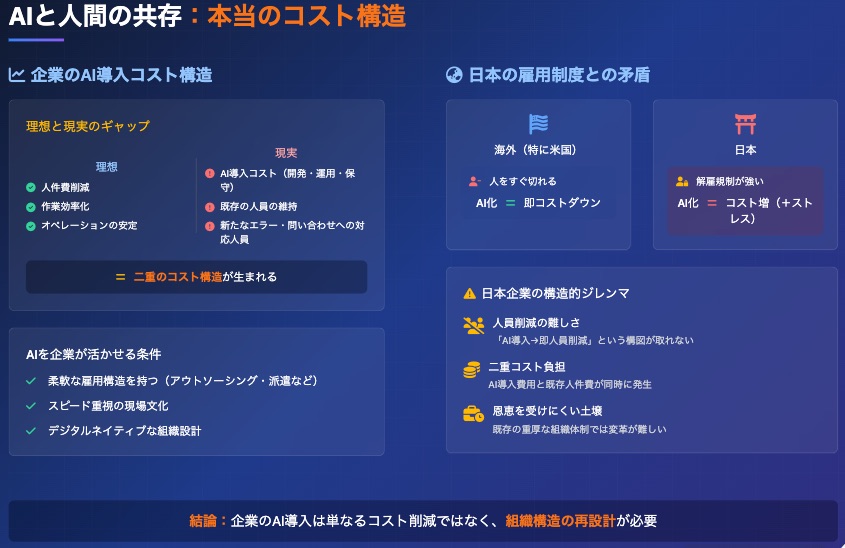

AIの企業導入におけるコスト構造に関して、

特に日本の企業においてはその構造がより複雑になります。

この点について、詳しく見ていきましょう。

企業のAI導入コスト構造:理想と現実のギャップ

AIや自動化技術の導入は、当初、企業に対して抜本的なコスト削減と効率化をもたらすという理想が掲げられていました。

- 理想:

- 人件費削減: AIが人の仕事を完全に代替することで、人員削減や配置転換による人件費の大幅な削減が期待されました。

- 作業効率化: 定型業務や単純作業をAIが高速かつ正確に処理することで、全体的な作業効率が向上すると見込まれました。

- オペレーションの安定: 人為的なミスを減らし、24時間稼働なども可能になることで、業務の安定性が高まると考えられました。

「完全な代替」ではなく、「不完全な補助」に留まっています。これは、セルフレジの例外対応にスタッフが常駐するケース、AIによるデータ処理後に人間の確認が必須となるケース、チャットボットが顧客のストレスを増加させ最終的に有人対応が必要となるケースなど、具体的な例で示されてきました。

この現実がもたらすのは、企業にとっての「コスト削減」という理想とは異なる、「コスト複合化」という状況です。

- 現実:

- AI導入コスト(開発・運用・保守): AIシステムの開発、導入、維持には当然ながら費用が発生します。

- 既存の人員の維持: AIが全ての業務を代替できないため、既存の人員を維持し続ける必要があります。特に、AI導入によって即座に人員削減ができない日本では、この負担が大きいです。

- 新たなエラー・問い合わせへの対応人員: AIが対応できない「例外」や「予測不能な問題」、あるいはAIが引き起こす「新たな問い合わせ」に対して、結局人間のリソースを割く必要が生じます。

その結果、「AIを導入しても全体のコストが増える」という二重のコスト構造になるケースが非常に多く発生しています。これは、AI導入の恩恵をフルに受けにくい土壌があることを示唆しています。

AIを企業が活かせる条件

では、どのような企業であればAI導入の恩恵を享受できるのでしょうか。

- 元々アウトソーシングや派遣など柔軟な雇用構造を持つ: 雇用が固定化されていないため、AI導入による業務効率化に合わせて人員配置を柔軟に変更し、コスト削減に直結させやすい構造です。

- 社内の現場がスピード重視で自動化に前向き: 組織全体として新しい技術の導入や業務プロセスの変更に積極的であり、試行錯誤を恐れない文化が根付いている場合です。

- 組織がデジタルネイティブな設計になっている: AIファーストな設計思想を最初から持っており、既存のレガシーシステムや慣習に縛られない、デジタルに最適化された組織体制を持つ企業です。

既存の重厚な組織体制を持つ企業では、このような柔軟な対応が難しく、AI導入のメリットを最大限に引き出すことが困難な現実があります。

日本の雇用制度との矛盾

この問題は、特に日本の雇用制度と深く関連しています。

- 海外(特に米国):

- 人をすぐ切れる: 雇用契約の解除が比較的容易な国では、AIによる自動化が進めば、それに伴って余剰人員を迅速に削減し、即座に人件費をコストダウンにつなげることができます。

- 日本:

- 解雇規制が強い: 日本では、労働者を容易に解雇できない法的な規制や慣習が存在します。そのため、「AI導入→即人員削減」という構図が取れません。

- この結果、AI導入のコストに加え、既存の人件費も継続して発生するため、「AI化=コスト増(+ストレス)」という状況に陥りやすくなります。

日本企業の構造的ジレンマ

日本の企業は、この制度的な制約によって、以下のような構造的ジレンマを抱えています。

- 人員削減の難しさ: AIが業務の一部を代替しても、法的な制約や社会的な反発から、すぐに人員を削減することができません。

- 二重コスト負担: AIシステムの導入費用と、AIが代替しきれない業務を担う既存の人件費が同時に発生し、総コストが増加する傾向にあります。

- 恩恵を受けにくい土壌: 既存の組織体制や雇用慣行が重厚であるため、AIの持つ柔軟性やスピード感と合致せず、その恩恵を十分に享受できない状況が生まれます。

企業のAI導入は単なるコスト削減ではなく、組織構造の再設計が必要

総じて、AIの企業導入は、単に技術的な問題やコスト削減策として捉えられるものではありません。それは、組織全体の構造、雇用慣行、そして企業文化そのものを見直し、再設計するという、より根本的な課題を突きつけるものです。特に日本では、この構造的ジレンマを乗り越えるための戦略的なアプローチが不可欠であり、AIが真に「手段」として機能するためには、その「課題」を見極め、解決するための組織的な変革が求められていると言えるでしょう。

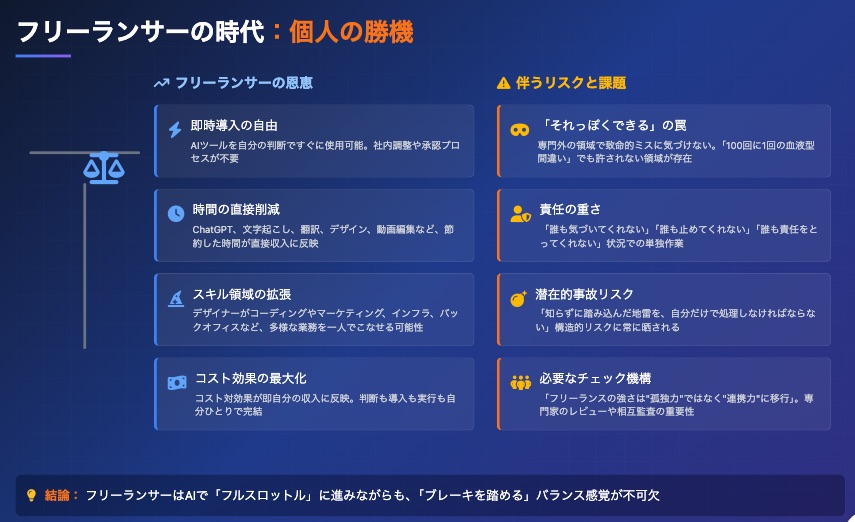

フリーランサーの時代:個人の勝機

AIの急速な進化は、働き方、特にフリーランサーにとって大きな変革の波をもたらしています。企業体がAI導入によるコスト増という構造的ジレンマに直面する一方で、個人、特にフリーランサーはAIツールを活用することで、これまでにない恩恵を享受し、自身の価値を最大化できる可能性を秘めています。

フリーランサーが享受するAIの恩恵

フリーランサーがAIから享受する最大の恩恵は、**「判断も導入も実行も自分ひとりで完結できる」**という、機動性と効率性です。

- 即時導入の自由:

- 企業とは異なり、フリーランサーはAIツールを導入する際に社内調整や複雑な承認プロセスが不要です。自分の判断で必要なAIツールをすぐに使えるため、ビジネスチャンスを迅速に捉え、実行に移すことができます。

- 時間の直接削減と収入への反映:

- ChatGPT、音声文字起こし、翻訳、デザイン、動画編集など、多岐にわたるAIツールを活用することで、自身の作業時間を直接的に大幅に削減できます。削減された時間は、新たな案件の獲得、スキルアップ、あるいは自由な時間として、直接的に自身の収入やQOL(生活の質)に反映されます。

- スキル領域の拡張:

- AIの助けを借りることで、一人のフリーランサーが持つ**「守備範囲」を飛躍的に広げることが可能**になります。例えば、従来のデザイナーがコーディング、マーケティング、インフラ、バックオフィス業務まで「それっぽく」こなせるようになるなど、多様な業務を一人でカバーできる可能性が生まれます。これにより、複数の専門性を持つ「一匹狼」型のフリーランサーが活躍できる土壌が形成されます。

- コスト効果の最大化:

- AIツールの導入コストは発生しますが、社内調整や教育・検証工程が不要なため、コスト対効果が即座に自分の収入に反映されます。これにより、効率的に利益を上げやすい構造となります。

このような理由から、「日本においては、一番得をするのは個人でなんでもやるようなフリーランサー」という考え方は非常に妥当であると評価されています。

伴うリスクと課題

しかし、AIがもたらす恩恵は、同時にフリーランサーに新たなリスクと課題を突きつけます。AIは「完全な代替」ではなく「不完全な補助」であるため、この点を誤解すると大きな事故につながる可能性があります。

- 「それっぽくできる」の罠:

- AIは多様な業務を「それっぽく」こなすことができますが、その精度や専門性には限界があります。デザインにおける致命的なミス、コーディングにおけるセキュリティホール、マーケティングにおける規約違反、会計における脱税リスクなど、「100回に1回でもミスが許されない分野」では「それっぽさ」は全く足りません。これは、まるで「100回に1回くらい血液型を間違えてもいいから輸血していい」とはならない、という比喩で的確に表現されています。

- 責任の重さ:

- フリーランサーはAIの力を借りて守備範囲を広げられる一方で、**「誰も気づいてくれない」「誰も止めてくれない」「誰も責任をとってくれない」**という構造的なリスクに常に晒されます。AIが引き起こした問題や、AIの不正確な出力によって生じたトラブルに対して、最終的な責任は全てフリーランサー自身が負うことになります。

- 潜在的事故リスク:

- 「知らずに踏み込んだ地雷を、自分だけで処理しなければならない」という状況に常に晒されることになります。AIは加速装置であり、その加速先に「人間の成熟」がなければ破綻します。つまり、「知性と責任が稚拙だと、加速しても不誠実な対価になる」という点が本質です。

- 必要なチェック機構:

- AI時代のフリーランサーの強さは、もはや「1人で全部完結させる力」といった**「孤独力」ではなく、「連携力」へと移行**します。AIによるリスクを制御するためには、自分一人で全てを抱え込まず、以下の「チェック機構」や「共創ネットワーク」を持つことが不可欠です。

- AI+人間によるクロスチェック構造を持つ: 自分が苦手な領域は専門家にレビューを依頼したり、複数のAI(GPTやClaudeなど)で比較評価したりする。最終判断は常に「人間が責任を持つ」前提を忘れないことが重要です。

- 信頼できる人間ネットワークの構築: フリーランサー同士で相互監査やレビューを行う場を設けたり、気軽に相談できるネットワークを日常的に確保したりすることが有効です。「1人で完結」にこだわらず、外注や分担を恐れない姿勢が求められます。

- AI時代のフリーランサーの強さは、もはや「1人で全部完結させる力」といった**「孤独力」ではなく、「連携力」へと移行**します。AIによるリスクを制御するためには、自分一人で全てを抱え込まず、以下の「チェック機構」や「共創ネットワーク」を持つことが不可欠です。

フリーランサーはAIで「フルスロットル」に進みながらも、「ここは自分にはわからないからAIの回答二を信じるにはリスクが発生する」と配慮するバランス感覚が不可欠

AI時代のフリーランサーは、AIを「楽をする道具」としてではなく、**「深掘りを加速する道具」**として捉えるべきです。AIプロンプトエンジニアと称して表面的なアウトプットだけを求めるような人材は、その価値が一時的なものに終わり、やがて淘汰されるでしょう。

真に価値のあるフリーランサーは、自身の専門分野を「縦に深く掘り下げる力」と、AIを使いこなしてその深掘りを加速させる力、そして他ジャンルの専門家と連携する力を兼ね備えています。

「フルスロットルで動かなければ恩恵は得られない」という側面は確かにありますが、同時に**「ブレーキを踏める自分」を同時に持っていないと、ある日大きな事故につながる**ことになります。このリスクとどう共生するかを考え抜き、自身の知性と責任を常に高めながら進める人が、AI時代の真の勝者になるでしょう。

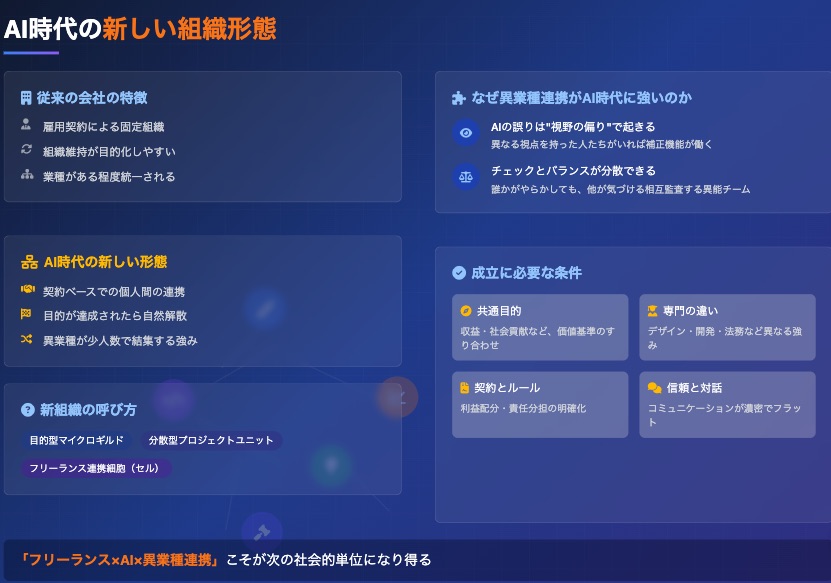

AI時代の新しい組織形態

AI時代における組織のあり方は、従来の固定的な企業形態から、より流動的で特定の目的達成に特化した形態へと変化する兆しを見せています。

従来の会社の特徴

従来の「会社(法人)」は、以下の性質を持っていました:

- 雇用契約による固定組織: 従業員との雇用契約に基づき、比較的固定された人員で構成されていました。

- 組織維持が目的化しやすい: 本来の事業目的とは別に、組織そのものを維持すること自体が目的となってしまうケースが少なくありませんでした。

- 業種がある程度統一される: 企業は通常、特定の業種や事業分野に特化し、その領域内で専門性を追求する傾向がありました。

AI時代の新しい形態

これに対し、AI時代に合理的でリスク耐性の高い「チーム形態」として浮上しているのが、目的型・流動型の少人数連携です。これは、以下の特徴を持ちます:

- 契約ベースでの個人間の連携へ: 雇用契約ではなく、プロジェクトや目的ごとの契約に基づいて個人が連携します。

- 目的が達成されたら自然解散: プロジェクトの目的が達成されれば、チームは柔軟に解散し、次の目的に合わせて再編されます。

- 異業種が少人数で結集する強み: 単一業種の専門家だけでなく、異なる専門性を持つ少人数のプロフェッショナルが結集することで、より多様な視点と能力を発揮します。

このスタイルは、「会社」という構造が必ずしも目的達成に最適ではないケースがAI時代には増えてくることを示唆しています。

新組織の呼び方

このような新しい集団形態には、以下のような呼称が提案されています:

- 目的型マイクロギルド: ゲーム開発における小規模な開発チームのように、特定の目的のために集まる小規模な専門家集団。

- 分散型プロジェクトユニット: geographically dispersed (地理的に分散した) メンバーがプロジェクトベースで連携する形態。

- フリーランス連携細胞(セル): 個々のフリーランサーが細胞のように柔軟に結合・離脱し、目的達成のために機能する組織。

これらの形態に共通するのは、「法人ではないが、組織的」であり、責任と役割が一時的に明確化されている点です。

なぜ異業種連携がAI時代に強いのか?

異業種連携がAI時代に特に強みを持つ理由は、主に二点挙げられます:

- AIの誤りは“視野の偏り”で起きる:

- AIがミスをするのは、「知らない」ことよりも「偏った視野を持っている」ことによって生じることが多いです。

- 異なる視点を持った人たちが連携すれば、AIの出力の偏りを補正し、より正確で多角的な解決策を導き出すことが可能になります。

- 例えば、デザイナーがUI設計をしても、インフラやマーケティングの視点がなければボトルネックが生じる可能性があります。AIが作成した契約文書も、法務の専門家がいなければ危険な抜け穴を見落とすかもしれません。

- チェックとバランスが分散できる:

- 異業種の専門家が連携することで、誰か一人が問題を引き起こしても、他のメンバーがそれに気づき、修正できる**「相互監査する異能チーム」**としての機能が働きます。

成立に必要な条件

このような新しいチーム形態を成立させるためには、いくつかの重要な条件があります:

- 共通目的: 収益、社会貢献など、チームメンバー間で価値基準や目指すべきゴールを明確にすり合わせる必要があります。

- 専門の違い: デザイン、開発、法務、営業など、メンバーそれぞれが異なる専門性を持ち、それがチームの多様な強みとなります。

- 契約とルール: 万が一に備え、利益配分や責任分担、プロジェクト終了後の取り決めなど、明確な契約とルールを設けることが不可欠です。

- 柔軟性: プロジェクト終了後は自然に解散できるという前提を持つなど、常に柔軟な形態を保つことが重要です。

- 信頼と対話: コミュニケーションが濃密でフラットであること、メンバー間の深い信頼関係がチームの円滑な運営に寄与します。

AI時代の“小さな会社”は、法人ではなく“志のある異業種個人の連携体”

従来の会社組織が最適だった時代から、「フリーランス×AI×異業種連携」こそが次の社会的単位になり得るという方向に向かっています。

これは、「会社に入らずともチームは作れる」という価値観の広がりでもあり、AIを最大限に活用しながら、個人の専門性と連携力を結びつける新しい働き方のモデルとなるでしょう。

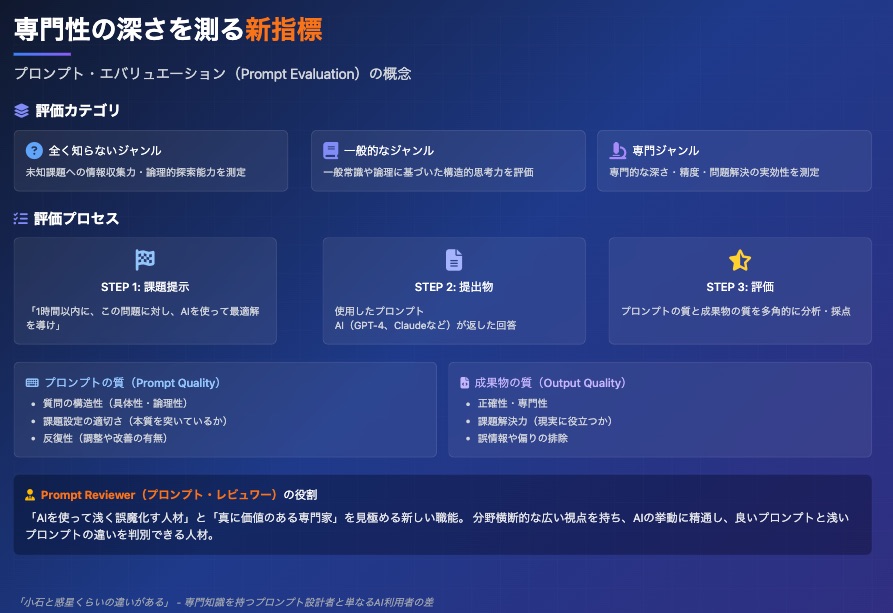

プロンプト・エバリュエーション(Prompt Evaluation)の概念

プロンプト・エバリュエーションとは、AIを活用した際の「プロンプトの質」と「その成果物の質」を評価することで、個人の専門性、思考力、そしてAIを真に使いこなす能力を測る新しい指標です。AIが誰でも使えるようになった一方で、同じ質問をしてもプロンプト次第で「小石」と「惑星」ほどの品質の差が出ることから、**「AI活用力」と「実際の専門性」**を評価することが今後ますます重要になります。

評価カテゴリ

この評価体系は、以下の3つのカテゴリで構成され、それぞれ異なる視点から個人の能力を測ります。

- 全く知らないジャンル

- 評価対象:プロンプト設計と成果物。

- 評価ポイント:未知の課題に対する情報収集力や、論理的な探索能力を測定します。文字通り、全く知識のない分野でも、AIを駆使してどこまで本質に迫れるかを見る視点です。

- 一般的なジャンル

- 評価対象:プロンプト設計と成果物。

- 評価ポイント:一般常識や論理に基づいた構造的思考力を評価します。多くの人が知っているような普遍的な知識領域において、AIを使ってどれだけ効率的かつ的確に情報を整理し、論理的なアウトプットを導き出せるかを測ります。

- 専門ジャンル

- 評価対象:プロンプト設計と成果物。

- 評価ポイント:専門的な深さ、精度、そして問題解決の実効性を測定します。個人の専門分野において、AIを単なる情報収集ツールとしてではなく、自身の深い知見と組み合わせて、どれだけ実践的で質の高いソリューションを生み出せるかを評価します。

評価プロセス

プロンプト・エバリュエーションは、以下の3つのステップで実施されます。

- STEP 1: 課題提示(Prompt Challenge)

- 評価対象者に「1時間以内に、この問題に対し、AIを使って最適解を導け」といった具体的な課題を提示します。これにより、限られた時間の中でAIを効果的に活用し、問題解決に臨む能力を試します。

- STEP 2: 提出物

- 評価対象者は、課題解決のために使用したプロンプトと、それによってAI(GPT-4、Claudeなど)が返した**回答(成果物)**を提出します。これにより、思考の過程と最終的なアウトプットの両方を評価可能にします。

- STEP 3: 評価

- 提出されたプロンプトと成果物の質を多角的に分析・採点します。このステップでは、以下の詳細な評価ポイントが用いられます。

- プロンプトの質(Prompt Quality)

- 質問の構造性(具体性・論理性): 質問が具体的で論理的に構成されているか。

- 課題設定の適切さ(本質を突いているか): 提示された課題の本質を捉え、適切なプロンプトでAIに問いかけられているか。

- 反復性(調整や改善の有無): 一度のプロンプトで終わらせず、AIの回答を受けてプロンプトを調整・改善する試みが見られるか。

- 成果物の質(Output Quality)

- 正確性・専門性: 成果物の情報が正確であり、専門分野において十分な深さを持っているか。

- 課題解決力(現実に役立つか): 提示された課題に対し、現実的かつ実効性のある解決策となっているか。

- 誤情報や偏りの排除: AIが生成しがちな誤情報や偏った見解が排除され、批判的に検討されているか。

Prompt Reviewer(プロンプト・レビュワー)の役割

この評価を行う人材(または機関)を**「Prompt Reviewer(プロンプト・レビュワー)」と呼びます。彼らは、「AIを使って浅く誤魔化す人材」と「真に価値のある専門家」**を見極める新しい職能です。

Prompt Reviewerは以下の特徴を持つ必要があります。

- 分野横断的な広い視点を持つ。

- AIの挙動に精通し、「良いプロンプト」と「浅いプロンプト」の違いを知る。

- 専門家の監修・指導を受けて評価基準を設定できる。

企業体においてこの職能が確立されれば、「AIを使って浅く誤魔化す人材」を除外し、「真に価値のある専門家」を見極める強力なツールになります。

「小石と惑星くらいの違いがある」 – 専門知識を持つプロンプト設計者と単なるAI利用者の差

「自分の知見から正解を見据えながら整えるようにAIに質問をする人」と、「全くわからず『それはなんですか?』とか『答えを教えてください』のようなプロンプトの人」の間には、**「小石と惑星くらいの違いがある」**

これは、AIが誰でも使えるようになったからこそ、その裏側にある**「人間の課題設定力」「問いの質」「専門知識に基づく判断力」**の差が、アウトプットの品質に決定的な影響を与えることを示しています。表面上はAIが生成した同じような成果物に見えても、その生成に至るプロンプトの深さや、それを設計した人間の専門性の有無によって、問題解決の実効性や信頼性は大きく異なるのです。

この評価システムを取り入れることで、企業は「AIが使える」と「AIで価値を生む」を明確に区別し、人材登用・採用・評価・教育の精度を向上させ、競争力を高めることができるでしょう。

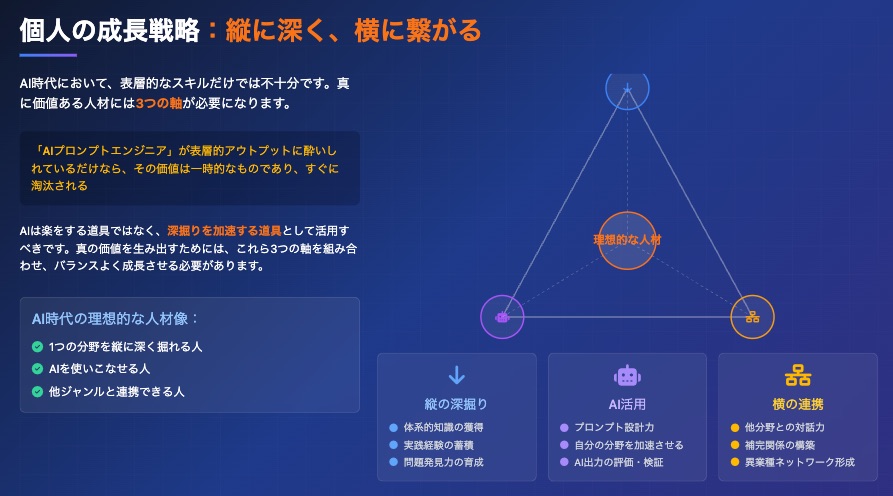

AI時代において、個人が真に価値ある人材として成長し続けるためには、表層的なスキルだけでは不十分であり、以下の3つの軸をバランス良く、かつ深く追求することが不可欠です。この戦略は、「縦に深く、横に繋がる」という概念によって最もよく表現されます。

AI時代の理想的な人材像:縦に深く、横に繋がる3つの軸

AIは「楽をする道具」ではなく、**「深掘りを加速する道具」**として活用すべきです。単にAIを使ってそれっぽいアウトプットを出すだけの「AIプロンプトエンジニア」は、その価値が一時的なものであり、いずれ淘汰されるでしょう。真の価値を生み出すには、これら3つの軸を組み合わせ、それぞれを深く磨き上げる必要があります。

理想的な人材は、以下の能力を兼ね備えた人物像として描かれます。

- 1つの分野を縦に深く掘れる人

- AIを使いこなせる人

- 他ジャンルと連携できる人

これらの軸を詳しく見ていきましょう。

1. 縦の深掘り:専門性の追求と構造化能力

AI時代においても、特定の分野における深い知識と経験は不可欠です。AIは知識を提供できますが、その知識が本当に意味を持つ文脈を生きながら発見するのは人間であり、**「本当に自分でやってみることの積み重ね」**によって、構造理解・定義力・質問力が磨かれます。

- 体系的知識の獲得: 自分の専門分野に関する知識を体系的に深く理解することです。

- 実践経験の蓄積: 知識だけでなく、実際に手を動かし、試行錯誤を通じて得られる経験です。AIが「正しさ」を教えても、「歩き方」「踏み方」「転び方」「戻り方」は自分で経験しなければ得られません。

- 問題発見力の育成: AIは課題を解決する「手段」に過ぎず、課題そのものを発見し、本質的な問いを立てる力は人間に依存します。自分の知見から正解を見据えながらAIに質問を整える能力は、全くわからずに質問する人とは「小石と惑星くらいの違いがある」と表現されます。

- 学習と教材化: 自分の専門領域を言語化し、初心者から専門家まで育てる教材を作成するプロセスは、自己の知識を構造化し、理解を深める最強の学習法です。これにより、自分の理解の穴や曖昧さに気づき、知識を他者に「教える」能力が養われます。

2. AI活用:プロンプト設計と成果物の評価・検証

AIを「使いこなせる」とは、単にツールを操作できるという意味に留まりません。AIを自分の分野を加速させるための強力な道具として活用し、その出力の質を評価・検証する能力が求められます。

- プロンプト設計力: AIから最適な解を引き出すための、質問の構造性(具体性・論理性)、課題設定の適切さ(本質を突いているか)、反復性(調整や改善の有無)を考慮したプロンプトを作成する能力です。このプロンプトの質が、AIの成果物の質を決定します。

- 自分の分野を加速させる: AIを自身の専門知識と組み合わせて、情報収集、分析、コンテンツ生成などを効率化し、専門的な深さや精度、問題解決の実効性を高めることを指します。

- AI出力の評価・検証: AIが生成した回答の正確性、専門性、課題解決力、誤情報や偏りの排除を批判的に評価する能力が不可欠です。AIが「それっぽいこと」を言えてしまう時代だからこそ、その深さをチェックする能力が求められます。

- 知性と責任の伴う活用: 「AIで加速されたあなたの知性と責任」に対価が発生するため、この知性と責任が稚拙だと、加速したところで不誠実な対価になってしまいます。AIは「中身を増幅する鏡」であり、成熟した思考と倫理がなければ、単なる「未熟の拡声器」になるリスクがあります。

3. 横の連携:異業種との協調と補完関係の構築

AIの活用が広がる中で、個人が抱えるリスク(例:専門外でのミスリードや事故)を軽減するためには、異分野の専門家との連携が非常に有効です。

- 他分野との対話力: 異なる専門性を持つ人々と円滑にコミュニケーションを取り、互いの知識や視点を理解する能力です。

- 補完関係の構築: AIの誤りは「視野の偏り」で起きることが多いため、異なる視点を持った人たちが連携することで、相互に補正機能が働き、課題解決の精度が高まります。

- 異業種ネットワーク形成: 少人数で異業種のフリーランサーが目的単位で一時的に集まる**「目的型・流動型の少人数連携」**は、AI時代の合理的でリスク耐性の高い「チーム形態」となりえます。これは、「フリーランスの強さは“孤独力”ではなく、“連携力”に移行していく」という新しい働き方を示唆しています。信頼できる人間ネットワークを通じて相互監査やレビューを行い、外注や分担を恐れずに「1人で完結」にこだわらない姿勢が重要です。

AI時代における個人の成長戦略は、自身の専門性を深く掘り下げ(縦の深掘り)、AIをその深掘りのための加速装置として使いこなし(AI活用)、そして自身の専門外のリスクや盲点を補完するために他分野のプロフェッショナルと積極的に連携する(横の連携)ことに集約されます。この3つの軸をバランスよく追求することで、個人はAIの波に呑まれることなく、AIを「人格の拡張」として使いこなせる真に価値ある人材へと進化できるでしょう。

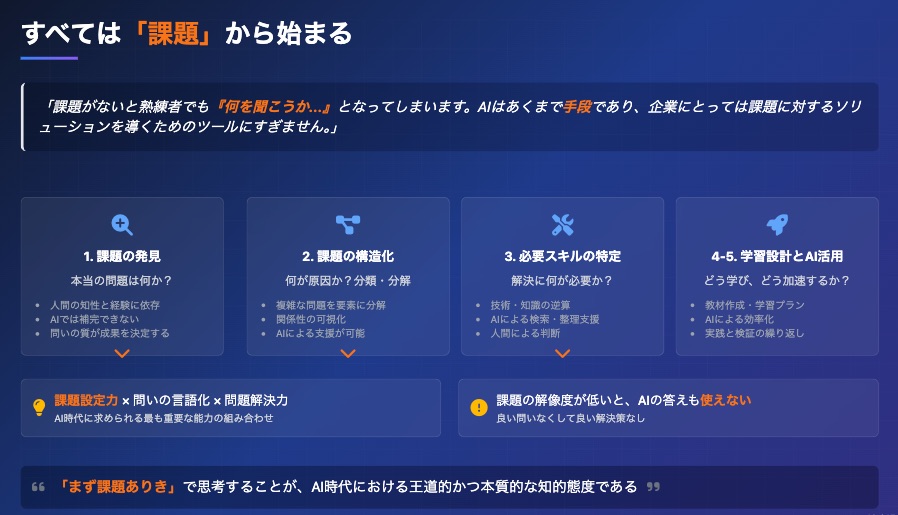

教材化による学びの加速:AI時代の「課題起点型学習」

AI時代における学習の核心は、「課題から教材を創る」ことにあります。AIはあくまで**「手段」**であり、企業にとって「課題に対するソリューションを迅速・的確に導くためのツール」に過ぎません。そのため、学習もまた、具体的な「課題」を起点として進めるべきです。

この学習プロセスは、以下の4つのフェーズに分けることができます。

- 課題設定

- 内容: 社内や自身の現場で本当に困っていること、解決すべき本質的な問題を抽出します。

- AIの役割: 無し(人間の役割)。AIは課題解決の「手段」を提供できますが、「課題そのもの」を発見し、本質的な問いを立てる力は人間に依存します。課題が明確でない場合、熟練者であってもAIに何を質問すべきか分からなくなってしまいます。

- 必要スキルの特定

- 内容: 課題を解決するために必要な技術や知識を逆算して特定します。

- AIの役割: 検索・整理支援。AIは関連情報の収集や整理を効率的に行い、必要なスキルや知識を特定する手助けをします。

- 教材化

- 内容: 特定したスキルや知識を、初心者から熟練者まで段階的に学習できるよう再構成し、教材として形にします。

- AIの役割: スライド・例題・プロンプト生成。AIは教材のコンテンツ生成、具体的な例題の作成、さらには学習を促すプロンプトの設計において強力なサポートを提供します。このプロセスで、AIを「自分の分野を加速させるプロンプト設計力」として活用することが重要です。

- テスト・評価

- 内容: 作成した教材やそれを通じて得られた成果物、演習結果に対して評価を行います。

- AIの役割: 自動添削・フィードバック支援。AIは学習者のアウトプットに対して自動添削を行ったり、改善のためのフィードバックを提供したりすることができます。

教材作成が「最強の学習法」である理由

「教えることができるということは、その知識を真に理解している証拠である」という考えは、まさにその通りです。教材を作成するプロセスは、自己の知識を深め、強化する上で計り知れないメリットをもたらします。

- 知識の構造化・抽象化

- 教えるためには、バラバラだった知識を整理し、概念間の関連性を明確にする必要があります。この「知識の構造化・抽象化」の過程こそが、理解を深める最も強力な方法です。自分の専門領域を言語化し、初心者から専門家まで育てる教材を作成するプロセスは、自己の知識を構造化し、理解を深める「最強の学習法」となります。

- 理解の穴の発見

- 教材に落とし込む過程で、「自分の理解の穴や曖昧さに気づける」という側面があります。他者に教えることを前提とすることで、自身の知識の不足や論理の飛躍を発見し、それを補強する機会となります。

- 対話ツールの創出

- 作成された教材は、単なる学習ツールに留まらず、「他者との対話ツール」ともなり得ます。チームや会社、さらには社会全体に価値を還元する手段となり、同時に個人の「ポートフォリオや信頼資産」としても機能します。これは、その人の「知の再現性と構造理解」を最もよく示すものとなります。

AIがどれだけ進化し、プロンプトの技術がどれほど巧みになっても、**すべての起点は常に「課題」**にあります。

すべては「課題」から始まる:AI時代の知的活動の核心

AIはあくまで**「手段」**であり、企業にとって「課題に対するソリューションを迅速・的確に導くためのツール」に過ぎません。しかし、「課題」が明確でなければ、熟練者であっても「何を聞こうか…」と戸惑ってしまうように、AIに何を質問すべきかさえわからなくなってしまいます。また、課題の解像度が低い場合、AIが出してきた答えも現実の解決策としては使えないものになってしまいます。

このことから、AI時代において最も重要視されるべきは、**「課題設定力 × 問いの言語化 × 問題解決力」**という能力の組み合わせです。

課題解決に向けた一連のプロセスは、以下の段階で構成され、それぞれにおける人間の役割とAIの役割が明確になります。

- 課題の発見(本当の問題は何か?)

- この段階は、人間の知性と経験に依存します。

- AIは既存のデータやパターンに基づいて回答しますが、「正解はわかっているのに、なぜできないのか」といった人間の行動や感情、あるいは利害関係、文化的・心理的な抑圧といった複雑な文脈を理解することはできません。

- また、「その共同体の知的限界を超えた構造から課題を定義する力」もAIには根源的に難しい領域です。AIは既知の知識や統計的傾向に基づいて応答するため、「誰も気づけない盲点」や「常識の外側から問題を定義する視点」は、人間が自身の経験、実践、観察、苦悩を通じてしかたどり着けない場所だからです。

- したがって、AI時代において、「問いの質」が成果を決定すると言えます。良い問いなくして、良い解決策は導き出されません。

- 課題の構造化(何が原因か?分類・分解)

- 複雑な問題を要素に分解し、それぞれの関係性を可視化するプロセスです。

- この段階では、AIによる支援が可能です。AIは情報の整理や関連性の抽出において効率的に機能します。

- 必要スキルの特定(解決に何が必要か?)

- 課題を解決するために必要な技術や知識を逆算して特定します。

- AIは関連情報の検索や整理を支援し、必要なスキルや知識を特定する手助けをします。しかし、最終的な判断や、そのスキルが本当に問題解決に繋がるかの見極めは人間が行います。

- 学習設計とAI活用(どう学び、どう加速するか?)

- 特定したスキルを習得するための教材作成や学習プランの設計を行います。

- このプロセスでAIを最大限に活用し、学習を効率化し加速させることができます。AIはスライドや例題、プロンプトの生成において強力なサポートを提供します。

- しかし、最も重要なのは「本当に自分でやってみることの積み重ね」です。AIは「正しさ」は教えてくれますが、「歩き方」「踏み方」「転び方」「戻り方」は教えてくれません。この実践を通じて、構造理解、定義力、質問力が磨かれ、AIでは代替できない人間の成長曲線を描くことができます。

AIの進化は**情報そのものの価値を大きく変容させています。**あなたの提示された「死んだ情報と生きる知識」のフレームワークは、AI時代における情報価値の本質を的確に捉えています。これはAIが「答えが決まっている操作を共にしない問いに関しては課題ではなくなった」という状況を生み出した結果と言えます。

AI時代における情報価値の変容:「死んだ情報」と「生きる知識」

AIが普及したことで、もはや**「ただ知識として知らないだけのノウハウ記事」などはその役目を終えた**と考えられます。

価値を失った情報(「死んだ情報」)

これらの情報は、AI(や検索エンジン)に質問すれば**「最短手順+実行方法が手に入る」**ため、人間がその知識を記憶したり、単純に羅列したりすることの価値が大幅に低下しました。

- 操作とセットでない知識

- 例:「スプレッドシートで条件付き書式の使い方」や「WordPressのパーマリンクの変え方」のような、**「答えが既に定まっていて、ただ知らないだけの情報」**は、AIに聞けばすぐに手に入ります。そのため、「知っているだけの人」や「ノウハウだけを書いた記事」は価値を失います。

- 単純比較記事

- 「おすすめ○○10選」や「MacとWindowsどっちがいい?」といった情報の羅列は、AIが即座にカスタマイズされた比較表を作成できるため、コピペ型の記事は価値を失います。

- 操作手順だけの動画

- 「Notionの使い方」や「Canvaでサムネイルを作る方法」のような、単にクリック操作の流れを追うだけの動画は、AIによる動画生成やインタラクティブガイドに置き換わっていくとされています。

- 感情や体験のないレビュー

- 「この製品、良かったです!便利でした!」といった個性のない一般的な感想や「買ってよかったランキング」のような情報は、AIがパーソナライズされたレビューを生成したり、SNSでの本音の比較の方が信頼されたりするため、価値が薄れます。

- 理屈のない提案系コピー

- 「この副業なら月10万円稼げる!」や「2025年はこのビジネスが来る!」といった、エビデンスのないテンプレート的な煽り系のコンテンツは、AIフィルターや批判的読解能力を持つ層に無視される傾向にあります。

これらの「死んだ情報」は、「操作とセットでない知識」であり、もはや「課題」ではないという認識に基づいています。

価値が高まる知識(「生きる知識」)

AI時代に価値が残るのは、人間の知性や経験、判断、そして「なぜそうするのか」という深い洞察を伴う知識です。

- 実践知 × 課題の文脈

- 単なる操作方法だけでなく、「なぜそうするのか」「他とどう違うのか」「どこで詰まるか」など、実地での判断や応用力が問われる知識はAIに代替されにくいです。AIは「正しさ」を教えてくれますが、「歩き方」「踏み方」「転び方」「戻り方」は教えてくれないからです。

- 意思決定プロセス

- 「どの選択肢をどう比較し、なぜその判断に至ったのか」という思考過程や判断の根拠は、AIが情報を整理しても、最終的に何を選び、信じるかは人間の判断基準にかかっているため、価値が高まります。

- 実装例・失敗例の共有

- 完璧な正解よりも、「うまくいかなかった話」や、そこから何を学び、どう改善したのかといった**「実践と検証の繰り返し」**から得られる知識こそが深い学びにつながります。

- 問いを立てる力・課題を定義する力

- AIは既存のデータやパターンに基づいて回答しますが、「本当の問題は何か?」を問い、その「課題を発見」する力は人間の知性と経験に依存します。AIでは補完できない、人間の知性の核心であり、「問いの質が成果を決定する」。例えば、「正解はわかっているのに、なぜできないのか」といった、人間の行動や感情、利害関係、文化的・心理的な抑圧といった複雑な文脈はAIには理解できません。また、「その共同体の知的限界を超えた構造から課題を定義する力」もAIには難しい領域です。

- 価値観・世界観を提示する思考

- 「なぜ今この事業をするのか」「社会のどこに価値のズレがあるか」といった、エビデンスを超えた個人の価値観や世界観に基づいた思考は、AIには代替できない人間の役割です。

AI時代の情報価値の移行:「操作知」→「構造知」→「判断知」へ

この変化は、AIが知識の取得と整理のプロセスを劇的に効率化したことで起こります。

- 「操作知」の終焉: 「どうすればよいか」という具体的な操作手順や、単なる情報の羅列は、AIが瞬時に提供できるため、もはやそれ自体に価値がありません。

- 「構造知」への移行: AIは情報間の関連性やパターンを認識し、複雑な問題を要素に分解・分類する「構造化」を支援できます。しかし、その構造を「本当に理解」し、「再構成」できるのは人間であり、特に**「専門ジャンルを初心者から専門家にまで育てる教材をプロンプトを使って作成し、それがプロの視点から成立するかを把握する」**といった行為は、深い構造理解を要します。

- 「判断知」の重要性: 最終的にAIが提供する情報や構造化された知識を基に、「何を信じ、何を選択し、どのように実行するか」という**「判断」を下すのは人間の役割です。この判断は、「知性と責任」**に基づいて行われ、「知性と責任が稚拙だと加速したところで不誠実な対価になる」という本質があります。

このことから、「問いの質こそが人間の価値になる時代が来た」と言えます。AIは加速装置であり、その加速先に「人間の成熟」がなければ、不誠実な結果につながる可能性があるのです。

AIの進化が目覚ましい現代において、AIが情報を高速で処理し、論理的な回答を導き出す一方で、依然として人間の領域としてAIが深く踏み込めない部分が存在します。それは、**「知性」と「責任」を伴う「人間の行動そのもの」**に関連するものです。

提示された内容に基づき、AIが踏み込めない人間の領域を詳しく解説します。

- 実行する力 AIは「運動すれば健康になりますよ」、「顧客にヒアリングしましょう」、「プロダクトを最小機能で出しましょう」といった**「こうすればいいですよ」という正論や解決策を提示できます。しかし、それらを「本当に実行することそのもの」**はAIにはできません。

- 例えば、恥ずかしい気持ちを押しのけて行動すること、思った通りにならなくても諦めずに続けること、他人と摩擦を起こすのを恐れずに意見をぶつけることなど、**身体的、感情的、社会的なリアルな摩擦を伴う「実行」**は、AIが踏み込めない、人間だけの領域です。

- 正解を知っていてもできない理由の理解 「正解はこうだ、みんなわかっている、にも関わらずできないのはなぜだ」という問いは、AIには本質的に理解できません。AIは「知識」や「方法論」には強いものの、「なぜ人がそれを実行できないのか」という問いに対しては、本質的に無力です。

- その理由としては、**「怖いから」「利害関係があるから」「空気を読んでいるから」「文化的・心理的な抑圧があるから」「過去のトラウマがあるから」**といった、構造的、感情的、歴史的な人間社会の複雑な文脈があり、AIはその存在感や重力場の中身を感じることができないためです。

- 盲点を見出す力 「その共同体の知的限界を超えた構造から課題を定義する力」も、AIには根源的に難しい領域です。AIは既存の知識や過去の統計的傾向に基づいて回答しますが、**「その場にいる誰にも気づけない盲点」や「常識の外側から問題を定義する視点」**は、人間が自身の経験や実践、観察、苦悩を通じてしかたどり着けない場所だからです。

- AIは既存のデータやパターンに基づいて回答しますが、「本当の問題は何か?」を問い、その「課題を発見」する力は人間の知性と経験に依存します [i]。

- 感情と文脈の理解 AIは、「共感・感性・創造性・倫理判断」など、定量化しにくい分野においては人間に代替されにくいとされています。

- 具体的には、空気を読む、文化的・心理的背景を感じる、過去のトラウマを理解するといった、構造的、感情的、歴史的な人間社会の文脈や力学はAIにとって不可解な領域です。AIはデータからパターンを認識しますが、その背後にある人間の複雑な感情や非言語的な文脈の「意味」を深く理解することはできません。

- 失敗からの回復と継続 AIは、完璧な「正解」を提示することはできますが、人間が直面する**「うまくいかなかった話」や、そこから何を学び、どう改善したのかといった「実践と検証の繰り返し」**から得られる深い学びには関与できません [i]。

- 思った通りにならなくても諦めずに続ける、他人と摩擦を起こすのを恐れずに意見をぶつける、そして挫折から立ち直るといった、身体・感情・社会のリアルな摩擦を伴う行為はAIには不可能です。

- 経験の積み重ね 「本当に自分でやってみることの積み重ね」によって、構造理解や課題定義力、質問力が磨かれることは、AIでは絶対に代替できない「人間の成長曲線」です。AIは「情報を持っている」に過ぎませんが、人間は「その情報が本当に意味を持つ文脈」を生きながら発見していきます。

- つまり、「やってみて、傷ついて、試して、語って、反省して、また定義し直す」という繰り返しを通じて得られる成長は、AIでは代替できない人間だけの領域であり、その積み重ねこそがAIと共に在る人間の強さになります。

- AIは「正しさ」までは教えてくれるけど、「歩き方」「踏み方」「転び方」「戻り方」は教えてくれない このフレーズは、AIが提示する知識や情報がどれほど正確であっても、それを現実世界でどのように適用し、実践し、困難に直面した際にどう対処するかという、生身の人間が直面する具体的なプロセスや感情、行動の側面をAIは教えることができないという本質を突いています。

- AIは「正しさ」を教えてくれますが、**「歩き方(実行への第一歩)」「踏み方(具体的な行動のコツ)」「転び方(失敗からの学び方)」「戻り方(軌道修正の方法)」といった、実践の中でしか得られない「行動知」や「実践知」**は、人間自身が経験を通じて獲得していくしかありません。

結論として、AIは知識や情報の処理・生成において圧倒的な能力を発揮しますが、人間の感情、経験、倫理、そして「なぜそうするのか」という深い洞察を伴う「判断」や「実行」の領域には、深く踏み込むことができません。AI時代においては、「問いを立てる力・課題を定義する力」 [i] や、「知性と責任が稚拙だと、加速したところで不誠実な対価になる」 という、人間自身の「地金」ともいえる部分の重要性が増していると言えます。

個人が今やっておくべき6つの実践軸

- 幅広いAIサービスの体験と比較

- 内容: GPT-4o、Claude、Perplexity、Mistral、Gemini、Midjourney、Runwayといった多様なAIサービスを実際に使い、それぞれの強みや弱みを肌感覚で掴むことです。

- 重要性: 表面的なプロンプト体験に留まらず、AIツールごとの特性や得意分野を理解することで、横断的に比較し、最適なツールを選び、使いこなせる人材が重宝されるようになります。AIはあくまで「手段」であり、様々なツールを使いこなす能力が、課題解決の質を左右します。

- 自分の専門の言語化・教材化

- 内容: 自身の専門分野を、初心者から中級、応用と段階的に階層化して解説できるよう、言語化し、教材として構成してみることです。

- 重要性: 専門知識を言語化し、構造化するプロセスは、自己理解を深めるだけでなく、AIに「教える」スキルとしても転用できます。AI時代における「教える力」は、知識の深さと構造理解の証明であり、AIがあっても、何を学び、どう学び、どう教えるかは人間の設計力・構成力・経験値に依存するからです。また、「課題から教材を創る」ことは、自己成長の最短ルートであり、自身の理解の穴や曖昧さに気づくための最強の学習法でもあります。

- 問いの練習(課題設定と質問力)

- 内容: 「この問題の本質は何か?」と常に自問する癖をつけることです。課題を明確にし、本質的な問いを言語化する力を鍛えます。

- 重要性: AIはあくまで「手段」であり、「課題」が明確でないと、熟練者でもAIに何を聞けばいいか分からなくなります。「問いの質がAI時代の知性を決定する」と言われており、良い問いを立てる人がすべてを先導する時代になります。AIが「答えが決まっている操作を共にしない問い」を解決できるようになった今、「問いの質」こそが人間の価値になることにほかなりません。

- ドキュメンテーション力の育成

- 内容: 複雑な手順や仕組みを、誰でも理解し、「再現可能な形」で他者に伝える練習をすることです。

- 重要性: AI(特にGPTのような言語モデル)と効果的に連携するためには、人間の意図や思考の構造を正確に言語化し、橋渡しする能力が不可欠です。曖昧な指示ではAIも適切なアウトプットを出せないため、構造と言語の正確な橋渡しができる力が求められます。

- 自分なりの「価値観」「判断軸」を持つ

- 内容: 例えば「最小工数」「社会貢献性」「収益性重視」など、仕事や意思決定における自分なりの明確な基準を持つことです。

- 重要性: AIは大量の情報を整理し、最適な選択肢を提示できますが、最終的に「何を選び、何を信じるか」は、個人の価値観や判断基準にかかっています。AIが加速装置である以上、その人の「知性」と「責任」が稚拙だと、加速したところで不誠実な対価になるため、明確な判断軸を持つことが重要です。AIは「その人の中身を増幅する鏡」に過ぎません。

- 他者との“弱いつながり”を意識的に増やす

- 内容: TwitterやSlack、Discordなどのオンラインプラットフォームを活用し、自身の専門分野を超えてAIユーザーと積極的に対話することです。

- 重要性: AIは既存の知識や統計傾向に基づくため、「その場にいる誰にも気づけない盲点」を見つけることができません。自身の見えない問いや気づきを、「別の視点」から受け取ることが、AIにはない人間最大の学習機会となります。フリーランスにとっては、「孤独力」ではなく「連携力」が強さに移行していく時代であり、異業種連携による相互監査やレビューは、AI時代の構造的リスクを制御する上で有効です。

今後大きな差がつく“隠れた実践領域”

A. 自分の作業ログをAI用に整理しておく * 内容: 普段行っている業務の中で、どこが毎回引っかかっているのか、どのようなプロセスを踏んでいるのかを記録・分析し、「AIに手伝わせられる工程」を可視化しておくことです。 * 重要性: この記録は、将来的に自分専用のAIアシスタントや、業務プロセスのオートメーションを設計する際に、そのまま活かせる貴重な資産となります。

B. 自分の“判断”の履歴を言語化して残す * 内容: 「なぜその選択をしたのか」「この場面では何を重視して判断したのか」といった、自身の意思決定の背景やプロセスを言語化して記録することです。 * 重要性: これができるようになると、AIに「自分っぽい思考パターン」を学習させ、再現させるトレーニングが可能になります。最終的に、AIに「自分の頭」を託し、自身の知性を拡張できる人間が、最も強くなるとされています。これは、AIが「加速されたあなたの知性と責任」に対価が発生するという考えの、実践的な応用とも言えます。

これらの実践は、AIの波に呑まれることなく、AIを**「人格の拡張」**として使いこなせる人材になるための基盤となります。AIは「正しさ」は教えてくれますが、「歩き方」「踏み方」「転び方」「戻り方」といった実践的な行動知は教えてくれないため、自らの経験を通じて構造を獲得していく姿勢が極めて重要です。

デジタル格差の新たな姿

AIの進歩は、社会に新たな層構造を生み出しつつあります。これは単なる経済的格差に留まらず、個人の思考や学習、判断の質にまで影響を及ぼし、不可視の階層社会を形成する可能性を秘めています。

1. AIリテラシーによる社会階層化

AIリテラシーの有無と深度によって、社会は主に以下の3つの層に分かれつつあります。

- AIを“使いこなす人”:

- AIを単なるツールとしてではなく、自身の能力を拡張する存在として捉え、課題定義、プロンプト設計、そして最終的な実行判断までを自ら行える層です。

- 彼らはAIによって価値創出力を飛躍的に高め、自己完結的に仕事を進め、収益を上げることができます。フリーランサーがAIの恩恵を最も受ける時代の勝者となりうるとされています。

- AIを“知っているが使いこなせない人”:

- AIの存在は認識しているものの、具体的なプロンプト設計や効果的な活用法を習得していない層です。

- 彼らは既存業務の自動化の恩恵を受け身で享受することはできますが、自身の判断や設計にAIを深く関与させることはできません。結果として、彼らの仕事はAIや上位層(AIを使いこなす人)に奪われたり、限定されたりする可能性があります。

- AIを“知らない人”:

- 地方や高齢者、デジタルツールに全く縁のない人々など、AIに関する情報のアップデートがない層です。

- 彼らはAIを活用した効率化の恩恵を享受できず、AIによって生成される**「最小工数で高品質なアウトプット」との価格競争にすら参加できない**状態に置かれます。

この格差は、単なる経済格差にとどまらず、**「思考速度」「判断精度」「学習効率」**といった個人の知的活動の質に差を生み出し、社会における「不可視の階層」を生み出す可能性を指摘されています。

2. 「作る側」と「買う側」の分断

このAIリテラシーの格差は、社会における役割分担を「作る側」と「買う側」に明確に分断する可能性を秘めています。

- 作る側(AI活用者):

- AI技術をツールとして自在に操り、短時間で高品質な成果物を生成できる人々です。

- 彼らは自分の判断で即座にAIを導入し、自身の時間を直接削減することで、その効率化が収入に反映されます。

- AIを「加速装置」として活用し、自身の「知性と責任」に基づいて価値を提供します。例えば、Copilotで5分で作成したプラグインであっても、それが顧客の課題を確実に解決し、安心を提供できるのであれば、そこに高い対価が発生します。

- 買う側(AI非活用者):

- AIの恩恵を直接的に受けることができないため、AI活用者が生み出す**「神速に効率化されたアウトプット」にお金を払うしかない**状況に直面します。

- 彼らは自分では再現できないレベルの成果物に依存せざるを得ず、「自分にはそもそもできない」という感覚が定着すれば、AIを活用する層への依存構造が生まれるとされます。

- 具体的な例としては、製品パッケージのデザイン、広告文章・商品説明文、補助金申請書類などが挙げられ、これらがAIとAI活用者によって瞬時に、かつ高品質に提供されるため、非活用者はそれに対価を支払う選択肢しか持てなくなる可能性があります。

3. 解決策:橋渡し人材の育成

AIリテラシーの格差を埋め、社会全体にAIの恩恵を広げるためには、以下のような「橋渡し」の役割を担う人材の存在が不可欠です。

- AIをわかりやすく伝えられる人: 地方や高齢者、情報弱者層に対し、AIの有用性や使い方を「使える形」で提供できる人。

- アナログ現場の業務を言語化できる人: AIが直接カバーしにくいアナログな業務知識や現場のノウハウを、AIが理解できる形に言語化し、AIと現場の橋渡しができる人。

- 共感しながら変化を促せる人: AIの導入を「押しつけ」ではなく、その地域の文化や現場の背景を尊重し、人々の共感を得ながら変化を促せる人。

これらの人材は、AIを活用できる層が「作る側」になり、そうでない層が「買う側」にならざるを得ないという構造の中で、「知の不均衡」を緩和し、社会全体でのAI活用を促進する重要な役割を担います。

4. 格差か機会か?

この新たなデジタル格差は、単なる技術的な問題ではなく、「格差」なのか「機会」なのかという倫理的・社会的な問いを投げかけています。現状では、**「自分でアクセスできる情報や技術に『気づけるかどうか』が、その人の“選択可能性の幅”を決定してしまう時代」**であるとされています。

これは、AIを「加速装置」と捉え、その加速先に**「人間の知性と責任」がどれだけ成熟しているか**によって、最終的な価値提供が「誠実な対価」になるか「不誠実な対価」になるかが決まるという、本質的な議論にもつながります。

したがって、AIの恩恵を社会全体に広げ、この格差を是正するためには、AIを活用する「知的中核層」が、単にAIを使うだけでなく、AIを教え、AIと多様な文化や知識の橋渡しをする役割を担っていくことが求められています。

AIで加速される「人間の地金」

AIは、その性質上、**「その人の中身を増幅する鏡」**にすぎません。これは、AIが人間の思考や判断を加速させる装置であるため、その加速の先に「人間の知性」と「責任」が伴わなければ、不誠実な結果をもたらすことを意味します。

1. 未熟な思考の増幅

AIによる加速が、もし人間の**「知性と責任が稚拙」**であるならば、それは「不誠実な対価」へと繋がりかねません。具体的には以下のような状況が生じます。

- 浅い理解 × AI = 浅いアウトプットの高速量産: AIは、与えられたプロンプトや情報に基づいて高速でアウトプットを生成しますが、人間の側の理解が浅ければ、表面的な、あるいは本質を捉えない成果物が大量に生み出されてしまいます。これは、「小石」と「惑星」ほどの品質の差を生むという指摘にも繋がります。

- 無責任な判断 × AI = 相手に不利益を与えるスピードだけが増す: AIは倫理判断や責任を負うことはできません。もし人間がAIを用いて無責任な判断を加速させれば、その影響はより広範囲に、そして迅速に悪影響を及ぼす可能性があります。例えば、セキュリティホールのあるコーディングや規約違反の広告などが、AIによって瞬時に生成されるリスクを孕んでいます。

- 過信 × AI = 本質を見失った”最適化された空虚”: AIが「それっぽくできる」ことに対する人間の過信は、真の問題解決や深いソリューションを見失わせる危険性があります。表面上は最適化されているように見えても、本質的な価値や意味を伴わない「空虚」な成果物になりがちです。

- 「中身が未熟なまま加速すれば、それは”未熟の拡声器”になる」: この言葉は、AIが人間の未熟さを増幅し、その影響を拡大させることを端的に示しています。AIは加速装置であり、その加速先に**「人間の成熟」がなければ破綻する**という結論に繋がります。

2. AIの手前にある人間の価値

AIが「速く・安く・うまく」できる時代だからこそ、真の価値や差を生むのは、AIでは代替できない**「人間の地金」**の部分です。

- 「なぜそれをこのように作ったのか」という判断: AIは最適な手順や方法を提示できますが、その選択の背景にある意図や思考プロセスは人間が持つべきものです。

- 「相手のために、どこまで考えを巡らせたか」という配慮: AIは情報処理は得意ですが、**クライアントの言葉の裏にある「恐れ」や「本当の目的」**を汲み取り、共感する能力は人間ならではのものです。

- 「どこに自分の責任を置いたのか」という覚悟: 最終的な「責任」は常に人間が持つべきであり、AIが生み出した成果物に対しても、その「知性と責任」が対価となるという考えが重要です。例えば、Copilotで5分で作ったプラグインであっても、それが顧客の課題を確実に解決し、安心を提供できるのであれば、そこに高い対価が発生します。

3. 成熟した思考の増幅

反対に、人間の知性や責任が成熟している場合、AIは非常に強力な味方となり、ポジティブな結果をもたらします。

- 深い理解 × AI = 洞察に満ちた高品質なアウトプット: 人間が深い知識や洞察力を持っていれば、AIを適切に活用することで、より高度で本質的な課題解決に繋がる成果物を生み出すことができます。

- 責任ある判断 × AI = 適切な速度での問題解決: AIは情報の整理や処理を高速で行いますが、それをいつ、どのように、どの程度の責任をもって利用するかは人間の判断に委ねられます。これにより、無責任な加速ではなく、適切かつ迅速な問題解決が実現します。

- 謙虚さ × AI = 人間の強みを活かした相乗効果: 人間がAIの限界を理解し、自身の得意分野とAIの得意分野を組み合わせることで、**「専門性+AI活用+他ジャンルとの連携」**という強固な価値を創造できます。

- 「成熟した思考と倫理を持っていれば、”善意の最速配達機”になる」: これは、AIが人間の善意や成熟した知性を最も効率的に社会に届け、価値を生み出す手段となりうることを示しています。

4. AIが問う「人間の地金」

AIが発達すればするほど、より根源的に問われるのは、AIでは代替できない以下のような「人間の地金」の部分です。

- クライアントの意図をどう汲み取るか: AIは言葉を解析できても、その背景にある「本当の意図」や感情、文脈を完全に理解することはできません。

- 言葉の裏にある”恐れ”や”本当の目的”をどう見抜くか: 人が行動できない理由、あるいは隠された動機などは、構造的・感情的・歴史的な人間社会の文脈の中にあり、AIはその中身を感じることができません。

- 最短ルートではなく、最善ルートをどう選ぶか: AIは効率的な「正解」を導き出せますが、「最善」とは何かという判断は、倫理観や社会性、人間関係を考慮した人間の知性に依存します。

- 間違えたとき、どう謝り、どう修正するか: AIは間違いを認めたり、謝罪したり、関係性を修復することはできません。これらの**身体・感情・社会のリアルな摩擦を伴う「実行」**は、人間だけの領域です。

結論として、AIは加速装置であり、その加速先に「人間の成熟」がなければ破綻するという点が強調されています。**「知性と責任が稚拙だと、加速しても不誠実な対価になる」**という言葉は、AI時代における職業倫理・経済活動・教育・社会的信頼の土台を貫く、深い真理であると言えるでしょう。

我々はどう生きるべきか

AI時代に「どう生きるべきか」という問いは、これまで議論してきた**「人間の知性、責任、そして成長」**というテーマの集大成であり、極めて本質的な問いです。AIは人間の能力を加速させるツールであるため、「その人の中身を増幅する鏡」にすぎません。したがって、AI時代を生き抜くためには、AIに代替されない「人間の地金」を磨き、AIを「善意の最速配達機」として使いこなす視点が重要になります。

これまでの議論を踏まえ、個人が今、そしてこれから取り組むべき生き方についてまとめます。

AI時代の「賢く、強く、誠実に生きる」ための原則

- 「課題」を起点に思考し、問いの質を極める AIは「手段」であり、「課題に対するソリューション」として存在します。AIがどんなに進化しても、「課題の発見」「問いの言語化」「問題解決力」といった、「何を聞けばいいかすら分からない」という状態からの突破は人間にしかできません。

- 本当に困っていること、解決すべき本質的な問題を定義する力を磨きましょう。

- AIに「答えを教えてください」ではなく、「何を知りたいのか」「なぜそれを知りたいのか」という**「問いの質」**を徹底的に深める練習をしましょう。

- 専門分野を「縦に深く」掘り下げ、「構造化」する AIが「それっぽく」何でもできるようになる時代だからこそ、表面的な知識や操作手順は価値を失います。

- 自分の専門分野を徹底的に深掘りし、体系的な知識と実践経験を積み重ねましょう。

- その知識を**「初心者からプロまで育てる教材」を作成する視点**で言語化・構造化する練習をしましょう。これは、自分の理解の穴を埋め、AIに「教える」スキルとしても転用できます。

- 「知っている」だけでなく、「なぜそうなのか」「どう応用できるのか」「どこで失敗するのか」といった**「実践知」や「構造知」**を追求しましょう。

- 「横の連携」と「相互監査」の力を高める AIは個人の守備範囲を広げますが、その裏には「誰も気づいてくれない」「責任を自分で負う」という構造的リスクがあります。

- 異なる分野のフリーランスや専門家と、目的単位で流動的に連携することを意識しましょう。これにより、AIの「視野の偏り」によるミスを補正し、相互にチェックし合う**「相互監査する異能チーム」**としての強みを発揮できます。

- SlackやDiscordなどを活用し、**「相談できる信頼できる人間ネットワーク」**を日常的に構築し、一人で抱え込まない「連携力」を磨きましょう。

- 「実行」と「経験」を通じて知性を磨く AIは「こうすればいいですよ」と教えてくれますが、それを**「本当に実行すること」そのもの**はAIにはできません。

- 「怖いから」「利害関係があるから」「空気を読んでいるから」といった、「わかっていてもできない」人間の感情や社会の文脈を理解し、乗り越えて行動する力を培いましょう。

- 身体的・感情的・社会的な摩擦を伴う「実行」を通じて、**「失敗から学び、修正し、また定義し直す」**という、AIでは代替できない「人間の成長曲線」を描きましょう。

- 「知性と責任」を持ってAIを活用し、価値を伝える AIによる加速の先に「人間の成熟」がなければ、それは「未熟の拡声器」となり、破綻を招きます。

- AIを用いて生成した成果物に対しても、その「知性と責任」が対価となるという意識を持ちましょう。

- **価値は「労力」ではなく「解決のインパクト」にあると理解し、AIで「最短で組み立てた」ものであっても、そこに「要件の解釈や使いやすさの調整」といった「あなたの専門性」**が活かされていることを誠実に伝えましょう。

- クライアントの「言葉の裏にある恐れや本当の目的」を見抜き、最短ルートではなく最善ルートを選ぶなど、人間ならではの洞察力や配慮を発揮しましょう。

- AI時代の「橋渡し役」としての役割を意識する AIは社会に知の格差を生み出し、「AIを使える人」と「AIを知らない人」の間で情報の非対称性が拡大します。

- AIを「つくる側」に立つだけでなく、AIを「教える」「翻訳する(文化や知の橋渡しをする)」という役割も意識しましょう。

- 特にデジタルに不慣れな層(地方、高齢者など)に対して、AIを分かりやすく伝え、具体的な形で提供できる**「共感しながら変化を促せる」人材**になることを目指しましょう。

結論として、AI時代における「生き方」は、AIを単なる効率化ツールとして捉えるのではなく、「人間としての本質的な価値(知性、責任、倫理、共感、創造性、課題定義力、実行力、人間関係構築力)をAIでどこまで加速し、社会に貢献できるか」**という視点に集約されます。自己の「地金」を磨き、AIをその増幅装置として活用することで、AIに脅かされる存在ではなく、AIを「人格の拡張」として使いこなせる存在へと進化できるでしょう。

事業グロース

事業グロース